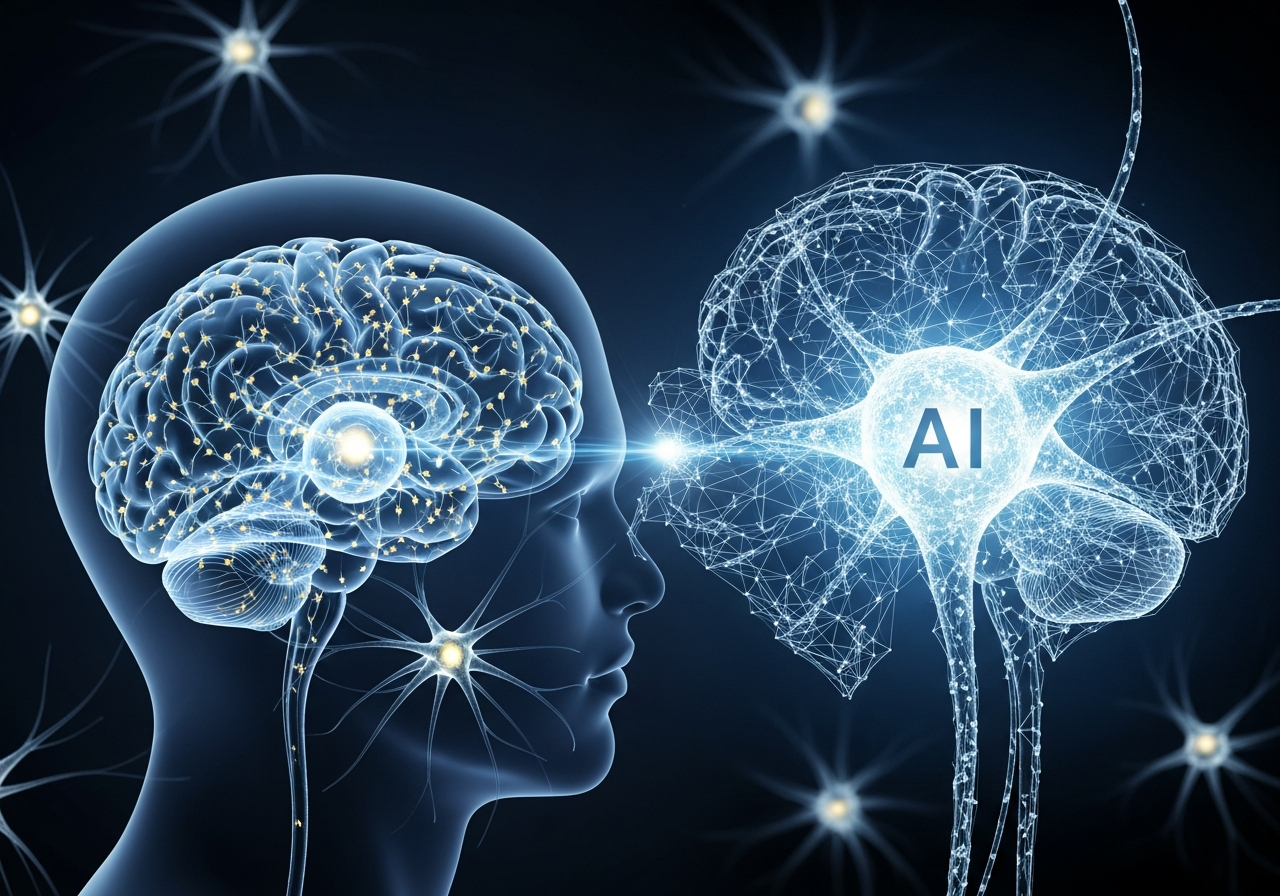

인간 뇌를 흉내 내자, AI가 더 똑똑·효율적으로

[서울=뉴스닻] 최승림 기자 = 영국 서리대학교(University of Surrey) 연구진이 인간 뇌의 신경망 조직 방식을 본뜬 새로운 학습·모델 설계를 제시했다. 해당 접근법은 생성형 AI와 챗GPT류 대형 모델에서 성능을 높이면서도 에너지를 크게 줄일 수 있다고 학술지 Neurocomputing에 보고됐다.

연구의 핵심은 Topographical Sparse Mapping(지형적 희소 매핑) 이다. 뇌가 공간적·의미적으로 가까운 뉴런만 연결해 정보 효율을 높이듯, 인공 신경망에서도 불필요한 원거리·무관 연결을 최소화한다. 연구진은 이렇게 ‘필요한 연결만 남기는’ 구조가 정확도를 해치지 않으면서 추론·학습 효율과 견고성을 모두 개선한다고 밝혔다.

강화 버전인 Enhanced Topographical Sparse Mapping 은 학습 과정에서 생물학적 시냅스 제거(pruning) 를 본뜬 동적 가지치기를 도입했다. 학습이 진행될수록 비효율 연결을 절제하고 유효 경로를 강화하여, 모델 복잡도를 줄이면서도 성능 저하를 막는다.

연구 책임저자인 로만 바우어(Roman Bauer) 박사는 “지능형 시스템을 훨씬 효율적으로 만들 수 있어 에너지 수요를 줄이면서 성능은 유지할 수 있음을 보였다”고 말했다. 그는 “요즘 인기 있는 대형 모델을 학습하는 데 수백만 kWh 전력이 들기도 하는데, 지금의 성장 속도로는 지속 가능하지 않다”고 덧붙였다.

연구진에 따르면 희소·국소 연결은 ▲메모리·연산량 축소 ▲오버피팅 억제 ▲네트워크 해석 가능성 향상 등의 부수 효과를 낳는다. 결과적으로 전력·하드웨어 비용을 절감하면서 대형 모델의 실제 배치성을 높일 수 있다.

팀은 해당 접근을 뇌 구조·기능을 모사하는 뉴로모픽 컴퓨팅 에 접목하는 후속 연구도 진행 중이다. 저전력 하드웨어와 결합하면 엣지 장치(로봇, 자율주행, 산업 IoT 등)에서 지연·전력 제약을 만족하는 경량 고성능 AI를 구현할 수 있을 것으로 기대하고 있다.

[저작권자 ⓒ 뉴스닻. 무단전재·재배포 금지]

최승림 기자 (seunglim.choi@newsdot.net)