엔비디아 차세대 AI 시스템 ‘베라 루빈’ 공개… 전력 효율 10배 향상

[서울=뉴스닻] 최승림 기자 = 엔비디아가 올해 하반기 출시 예정인 차세대 인공지능(AI) 시스템 ‘베라 루빈(Vera Rubin)’을 처음 공개했다. 회사 측은 기존 제품 대비 전력당 성능이 10배 향상됐다고 밝히며, 전력 소비 문제가 커지고 있는 AI 인프라 시장에서 새로운 전환점이 될 것이라고 강조했다.

전력은 2배, 효율은 10배

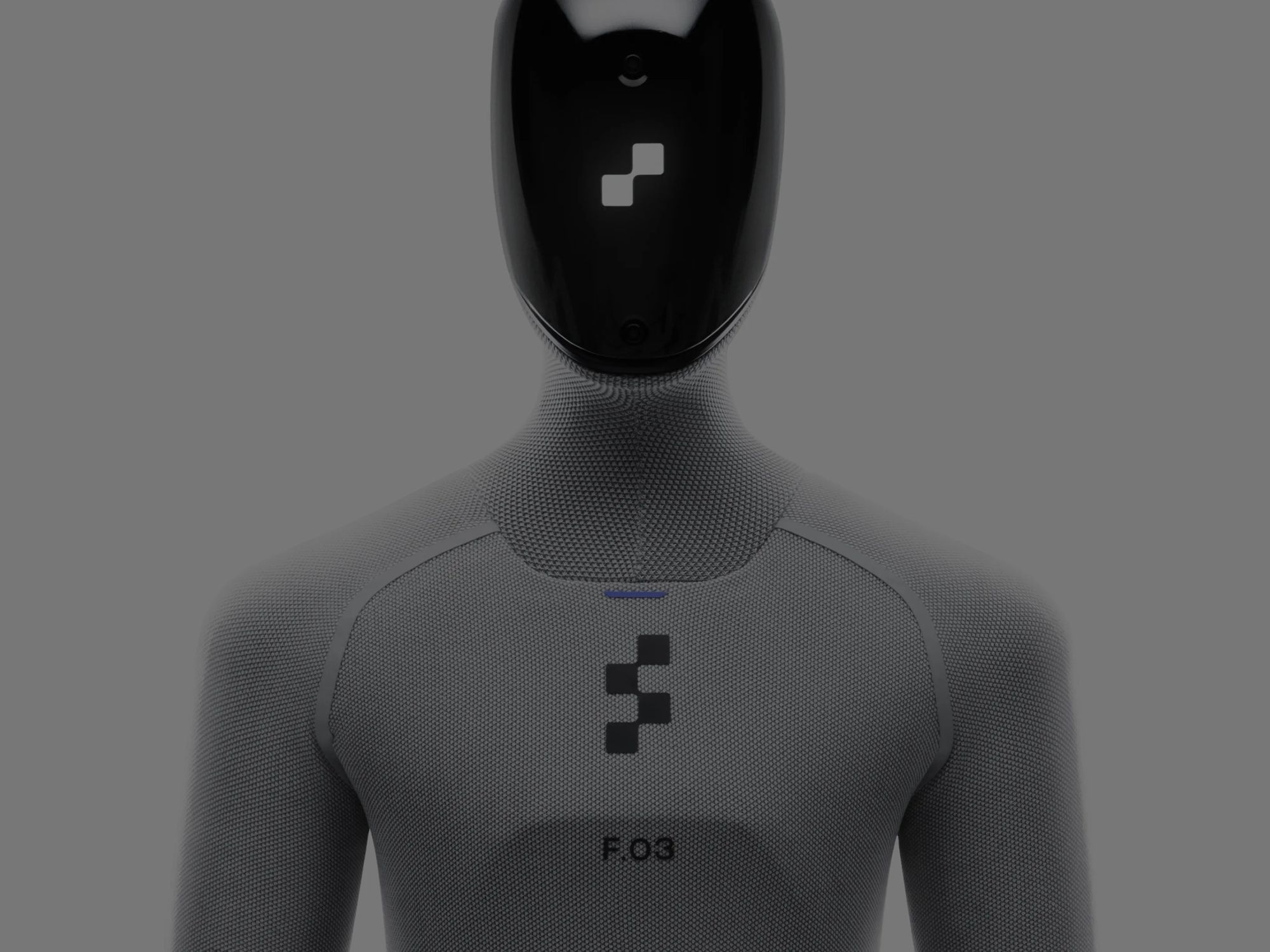

베라 루빈은 이전 세대 시스템인 ‘그레이스 블랙웰(Grace Blackwell)’의 후속 모델이다. 전체 구성 부품만 약 130만 개에 달하는 초대형 랙(rack·서버 묶음) 시스템으로, 72개의 루빈 GPU(그래픽처리장치)와 36개의 베라 CPU(중앙처리장치)를 핵심으로 한다. 주요 칩은 대만 TSMC가 생산한다.

엔비디아에 따르면 새 시스템은 이전 모델보다 전력 사용량이 약 두 배 늘어나지만, 단위 전력당 처리 성능은 10배 향상된다. AI 산업에서는 ‘전력 1와트당 얼마나 많은 연산을 처리하느냐’가 핵심 지표로 꼽히는데, 이를 크게 끌어올렸다는 설명이다.

130만 개 부품, 20개국 공급망

베라 루빈은 단순한 서버를 넘어 전 세계 20개국 이상, 80여 개 협력사에서 공급받은 부품으로 구성된다. 액체 냉각 장치, 전력 시스템, 연산 모듈 등이 유기적으로 결합된 구조다. 무게만 약 2톤에 달한다.

특히 이번 시스템은 100% 액체 냉각 방식을 적용했다. 데이터센터는 과열을 막기 위해 대량의 전력을 소모하는데, 액체 냉각은 열을 더 효율적으로 식혀 물 사용량과 에너지 낭비를 줄일 수 있는 방식이다. 엔비디아는 이를 통해 기존 증발식 냉각보다 물 사용량도 낮출 수 있다고 밝혔다.

고객사 확대… 경쟁도 심화

메타는 2027년부터 자사 데이터센터에 베라 루빈을 도입할 계획이라고 발표했다. 오픈AI, 앤트로픽, 아마존, 구글, 마이크로소프트 등도 잠재 고객으로 거론된다. 가격은 공개되지 않았지만, 업계는 한 대당 약 350만~400만 달러 수준으로 추정하고 있다.

다만 엔비디아의 독주에 대한 견제도 거세지고 있다. AMD는 자체 랙 단위 AI 시스템 ‘헬리오스(Helios)’를 준비 중이며, 구글과 아마존도 자체 반도체(TPU, 트레이니움)를 데이터센터에 확대 적용하고 있다. 한 증권사 애널리스트는 “고객사들은 공급 안정성과 협상력을 위해 ‘제2의 공급처’를 원한다”고 분석했다.

엔비디아는 2029년까지 미국에서만 최대 5,000억 달러 규모의 AI 인프라를 생산할 계획이다. AI 연산 수요가 폭증하는 가운데, 베라 루빈이 차세대 데이터센터 표준으로 자리 잡을지 주목된다.

[저작권자 ⓒ 뉴스닻. 무단전재·재배포 금지]

최승림 기자 (seunglim.choi@newsdot.net)